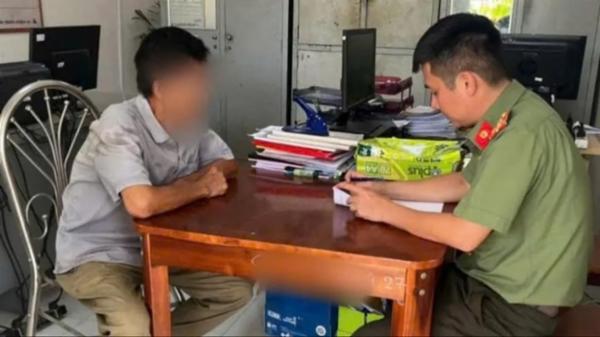

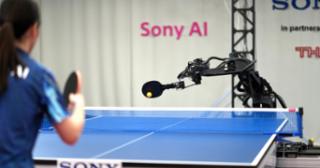

Xuất hiện hành vi ghép mặt, giọng nói giống hệt người thân để lừa đảo

Các đối tượng sử dụng công nghệ Deepfake AI, tạo ra các sản phẩm công nghệ âm thanh, hình ảnh và video với độ chính xác rất cao để lừa đảo.

26/03/2023 07:48

Link báo gốc:

https://infonet.vietnamnet.vn/xuat-hien-hanh-vi-ghep-mat-giong-noi-giong-het-nguoi-than-de-lua-dao-5017256.html

-

1Chồng chém vợ và con 2 tháng tuổi tử vong

-

2Khởi tố tài xế trong vụ cháy xe ở cây xăng khiến 2 người tử vong

-

3Đẩy nhanh xây kè chống sạt lở sông, rạch

-

4Mưa đá và dông lốc gây thiệt hại ở Hà Nội và một số tỉnh miền Bắc

-

5Đà Nẵng khởi tố, bắt tạm giam đối tượng vi phạm phòng cháy, chữa cháy gây ra vụ cháy ô-tô làm 2 người tử vong

-

6Đón không khí lạnh, chiều và đêm mai Hà Nội có mưa cục bộ, có nơi mưa to đến rất to

-

7Covid-19, sốt xuất huyết và não mô cầu đồng loạt tăng mạnh

-

82 tàu cá bốc cháy trong đêm tại cảng cá Mỹ Tân

-

9Sau 3 ngày nghỉ lễ, xử lý hơn 8.700 trường hợp vi phạm nồng độ cồn

-

10Thời tiết ngày 4/5: Bắc Bộ có mưa rào và dông, Nam Bộ ngày nắng

-

11Khối không khí lạnh đang ảnh hưởng tới miền Bắc

-

12Huy động lực lượng tìm người nước ngoài mất tích ở hồ Đá Đen

-

13Bé gái 22 tháng tuổi bị tổn thương nghiêm trọng do chó cắn

-

14Người dân trở lại TPHCM đông, cửa ngõ miền Tây kẹt xe kéo dài

-

15TP Đồng Nai: Nâng cấp 4 tuyến quốc lộ

-

16Vì yêu mà đến, vì thương mà ở lại Côn Đảo

-

17Thời tiết ngày 3/5: Bắc Bộ mưa to diện rộng, Nam Bộ nắng nóng

-

18Vượt nắng nóng, xuyên lễ thi công đường băng số 2 sân bay Phù Cát

-

19Quảng Trị bắt đối tượng gây ra án mạng trong gia đình

-

20Giúp tuyến dưới nâng cao năng lực khám bệnh, chữa bệnh

Quay lại

Quay lại